「Bing Webマスターツールを使ってみて分かったこと」というエントリーを書いて以来、これまで敷居が高いと感じていたGoogleのウェブマスターツールに親近感を覚え始めた。【※ウェブマスターツールは、今年からGoogle Search Consoleに名称変更したとか。】

Search Consoleで確認できるクロール統計の数値をアップすることがSEOの近道らしいとの情報を得たので、クロール対策に取り組んだ次第を書いてみることに。

クロール統計情報は要チェック

ネット上に数多あるGoogle Search Console(ウェブマスターツール)の解説記事を読んで、先週以来あらためてSEOに取り組んでみた。それというのも、SEO関連記事では必ず上位表示されるバズ部さんの「Webクロールの巡回数を確認する方法」という記事を読んでしまったからだ。バズ部さんによると、クロールの頻度が1日に100回を超えると月間10万アクセスになるらしい。

クロールの巡回頻度はSEOにとって重要であり、たいていクロール頻度が1日に100回以上を超えると月間10万アクセスほどの規模になる。

クローラーの巡回数を正確に計測するなら専門家によるサーバーのモニタリングが必要となり、またコストもかかる。通常なら敷居の高い計測ツールをウェブマスターツールでは無料で提供しているのだ。定期的にチェックする手はない。

また、別サイトの記事では、ある時点でクロール統計情報の折れ線グラフがピョンと跳ね上がっている場合はいいことが起こる予兆だという。ウェブマスターツールで826村のデータを見てみると、なんと!!!下図のとおり、9/16にビヨ~~ンと上がっているではないか。

9/16の跳ね上がりがアクセスアップの前兆であるなら、急いで今できるSEO対策を!となったわけ。

Sitemap.xmlとRobts.txtが肝要

それでバズ部さんの記事を参考に、GoogleBotと仲良くするために最重要課題と思しき対策を2つ。まずはプラグイン「Google XML Sitemaps」の導入、そして「robots.txt」の設定。

XML sitemapは「All in One SEO Pack」プラグインで設定済みなので要らないようにも思えたが、「Google XML Sitemaps」のほうが長けているらしく思えたので、All in OneのXML SitemapsをDeactivateにして「Google XML Sitemaps」をインストール>有効化>設定。その後sitemap.xmlのURLなどを記した「robots.txt」を作成アップした。

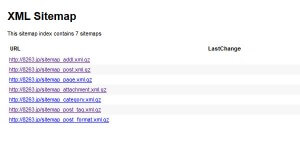

そして確認のためhttps://8263.jp/sitemap.xmlにアクセスすると、なぜか期待した画面が出てこない。予習通りなら、タイトルはXML Sitemap Indexのはずだが何か変!右の写真は、期待に反して出てきた画面のキャプチャ。

そして確認のためhttps://8263.jp/sitemap.xmlにアクセスすると、なぜか期待した画面が出てこない。予習通りなら、タイトルはXML Sitemap Indexのはずだが何か変!右の写真は、期待に反して出てきた画面のキャプチャ。

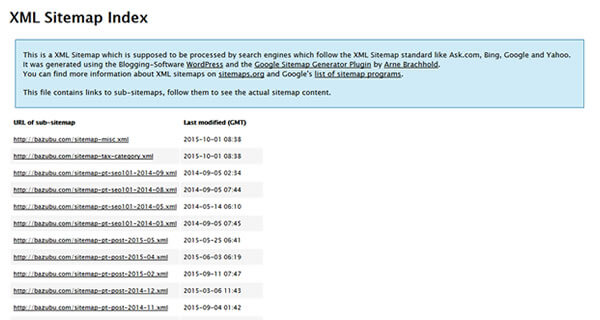

バズ部さんの説明によると下に示す画面になるはずなのに!どうしたことか?

ウェブマスターツールで確認すると、アクセスエラーが出ている。正常に機能していないらしい。

Google XML Sitemaps最新版の設定

Google XML Sitemapsプラグイン(XML Sitemap Generator for WordPress 4.0.8)の設定画面を見ると、英語表記ではあったが赤字でsitemap.xmlを削除せよ!とあったので削除してみた。削除するとプラグイン設定画面ではエラーが消えた。ところが、ウェブマスターツールでは相変わらずエラーとなっている。

バズ部さんで情報を探してみても、それらしい情報を見つけることができなかったので『XML Sitemap Generator for WordPress エラー』で検索をかけてみたら、バージョン4.0以降XMLサイトマップを動的に作成するように仕様変更があったとのこと。

Googleに知らせるサイトマップアドレスもドメイン直下のsitemap.xmlから

index.php?xml_sitemap=params=

に変更となっていた。なので、FTPソフトで覗いてもドメイン直下にはサイトマップらしきファイルは見当たらないわけだ。FTPでは確認できなくても、アドレスを新方式で指定したら、このサイトのXMLmapもバズ部さんのキャプチャと同じ仕様のものが確認できるようになった。

826村のXML Sitemap

リンク先を見ると分かるように、この記事の更新についてもきちんと反映してくれているようだ。

Google XML Sitemapsプラグインの4.0以上を使う場合は、robots.txtの書き方にも要注意。

Disallow: /*?

が書いてあると、アクセス拒否になってしまい、ロボットはサイトマップを認識できない。

これは私が失敗から得た教訓。しばらく悩んでようやく思いついた次第。

Google XML Sitemapsプラグインの4.0以上の設定で悩む方々の参考になれば幸いだ。

コメント